PoCから本番へ:RAGの精度・コスト・速度を最適化する実践的実装ガイド

- RAGの実装における基本的な限界と課題

- 単純なベクトル検索の限界

- 文脈断絶問題の影響

- キーワード検索の弱点と改善

- データの切り出し(Chunking)の戦略的アプローチ

- Markdown階層分割の利点

- Small-to-Big Context法の応用

- 検索(Retrieval)の精度を最大化する手法

- ハイブリッド検索の仕組み

- クエリ書き換え技術の重要性

- Self-Queryingによるフィルタリング

- メタデータ活用による検索範囲の絞り込み

- リランク(Re-ranking)と後処理の改善手法

- Cross-Encoderの再評価プロセス

- 軽量リラカーモデルの選択基準

- 不要情報除去による結果改善

- 評価指標の導入とモニタリング手法

- Ragasで計測する忠実性指標

- 回答関連性の評価方法

- 定量評価によるモニタリングの流れ

- 改善サイクルへのフィードバック手法

- コスト最適化を実現するための工夫

- 高価なLLM依存の軽減策

- 軽量モデルと前処理の組み合わせ

- コスト対効果の高い実装例

- 低レイテンシ実現に向けた実装戦略

- 応答速度向上のための技術

- 高度な処理を支える実装方法

- RAG実装における評価・改善プロセスの手法

- 評価から改善へのプロセス構築

- フィードバックループの設計

- 改善手法の選定基準

- 評価結果を活用した最適化

- アンチパターンと避けるべき実装の落とし穴

- 過度な分割のリスク

- メタデータ詰め込みすぎの弊害

- アンチパターン回避のためのチェックリスト

RAGの実装における基本的な限界と課題

RAG(Retrieval-Augmented Generation)の実装において、開発者が直面する主な課題は、単純なベクトル検索やキーワード検索の限界、そして文脈断絶問題です。これらの課題は、RAGの精度や効率を最適化する上で避けては通れないものです。

単純なベクトル検索の限界

ベクトル検索は、文書の意味を捉える手法として広く利用されています。

しかし、単純なベクトル検索では、細かな文脈やニュアンスを見逃してしまうことがあります。

例えば、ベクトル空間で近い位置にあるものが、必ずしもユーザーの意図に最も合致するとは限らないのです。

このため、ベクトル検索だけに頼ると、関連性の低い情報が引き出されるリスクが存在します。

文脈断絶問題の影響

文脈断絶問題は、RAGにおいて特に重要な課題です。

文書から特定の情報を抽出する際に、その情報がどの文脈で述べられているかが不明確だと、誤解されたり、無関係な答えが生成されたりすることがあります。文脈の断絶を防ぎ、情報を一貫して提供するには、文脈を保持したデータの取り扱いが求められます。

キーワード検索の弱点と改善

キーワード検索は特定の単語に依存するため、意味が曖昧な問合せに対しては不十分です。

例えば、「雲」と検索すれば、天気の雲、クラウドコンピューティング、さらには詩的な表現まで引っかかる可能性があります。

この弱点を補うために、クエリ拡張や意味検索を取り入れることが重要です。

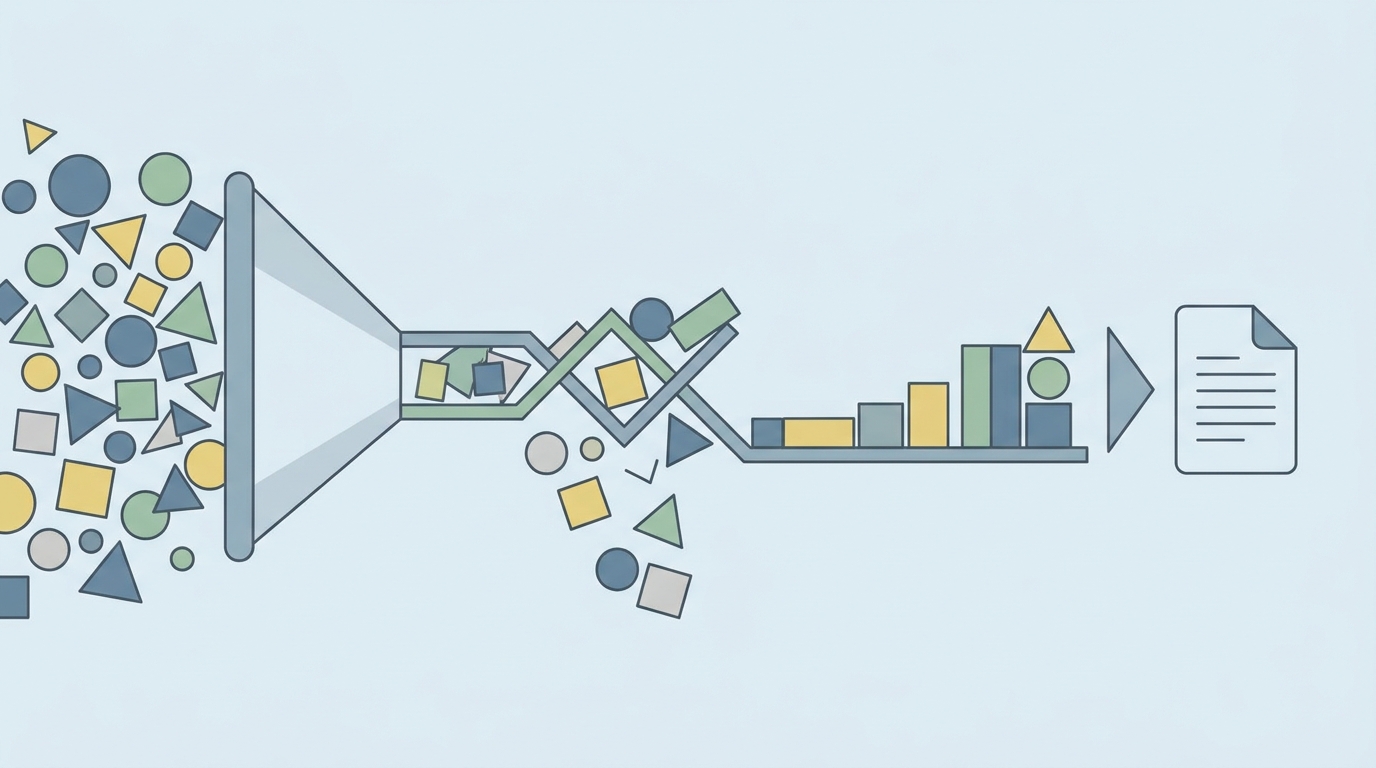

データの切り出し(Chunking)の戦略的アプローチ

RAGの効果的な実装には、データの切り出し、つまりチャンク化の戦略が非常に重要です。

適切なチャンク化は、検索精度や生成するコンテンツの質を向上させる鍵となります。

Markdown階層分割の利点

ドキュメントの構造(#, ##, - )を意識して分割します。Markdown階層を利用した分割は、文書の構造を保ちながら情報を整理するのに役立ちます。

Markdownの見出しやリストを基準にデータをチャンク化することで、関連情報をまとめて取り扱うことができ、検索や生成の際に文脈を保つことができます。これにより、より一貫した回答を生成することが可能になります。

Small-to-Big Context法の応用

Small-to-Big Context法は、小さなチャンクを検索に使い、関連する大きな文脈を生成に活用する方法です。

検索の際には100から200トークンの小さなチャンクを使用し、回答生成時にはその周囲の大きな文脈を含めることで、情報の一貫性を保つことができます。この方法は、検索精度を高めつつ、回答の質を向上させる非常に効果的な手法です。

-

Small(100-200 token): 検索ヒット率を高めるために細かく分割。

-

Big(Parent Document): ヒットした際、その周辺の大きな文脈をLLMに渡す。

# LlamaIndexでの実装イメージ

from llama_index.core.node_parser import HierarchicalNode_Parser

# 親ノード(800枚)と子ノード(200枚)を紐づけて管理

node_parser = HierarchicalNode_Parser.from_defaults(chunk_sizes=[800, 200])

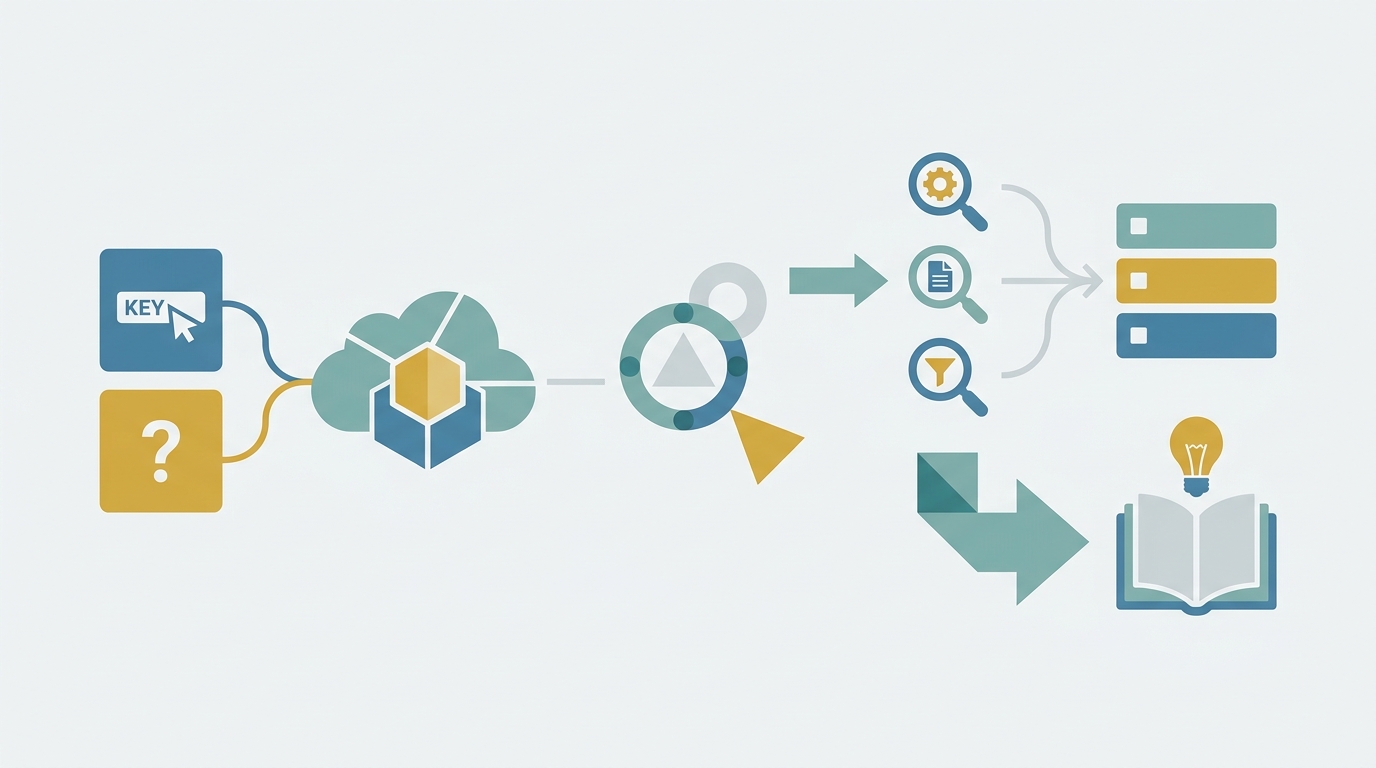

検索(Retrieval)の精度を最大化する手法

検索精度を高めることは、RAGの成功に不可欠です。

ここでは、特にハイブリッド検索、クエリの書き換え、Self-Querying、メタデータ活用といった精度向上の手法を見ていきます。

ハイブリッド検索の仕組み

ハイブリッド検索は、ベクトル検索とBM25などのキーワード検索を組み合わせたアプローチです。

これにより、固有名詞への対応力と意味的な関連性を同時に高めることが可能です。異なる検索手法を補完的に使うことで、より精度の高い検索結果を得ることができます。

クエリ書き換え技術の重要性

クエリ書き換えは、ユーザーの曖昧な質問を検索に最適化するための技術です。

例えば、HyDEのような手法を使って、クエリを意味的に豊かな形に変換し、より適切な検索結果を得ることができます。

このプロセスは、特に曖昧な検索クエリに対して有効です。

Self-Queryingによるフィルタリング

Self-Queryingは、クエリに基づいて自動的にメタデータフィルタを生成し、検索範囲を絞り込む技術です。

これにより、対象を明確に定め、無関係な結果を排除できます。特に大量のデータセットを扱う場合に、精度を高めるのに役立ちます。

メタデータ活用による検索範囲の絞り込み

メタデータを活用することで、検索条件を絞り込み、より関連性の高い情報を効率的に取得できます。

例えば、著者や発行日、トピックなどのメタデータを利用することで、検索結果の精度をさらに高めることができます。

リランク(Re-ranking)と後処理の改善手法

検索結果をそのまま利用するのではなく、リランクや後処理を施すことで、より精緻な出力を得ることができます。

ここでは、Cross-Encoderや軽量リラカーモデルの使用、不要情報の除去といった手法を検討します。

Cross-Encoderの再評価プロセス

Cross-Encoderを使用した再評価は、検索結果の上位を精査し、真に関連度の高いものに順位を付け直すプロセスです。

これにより、単なる検索では見落とされがちなニュアンスや関連性を考慮に入れ、より精度の高い情報が得られます。

軽量リラカーモデルの選択基準

リランクには軽量モデルを用いることが効果的です。

例えば、Cohere RerankやBGE-Rerankerといったモデルは、高精度でリアルタイムに近い結果をもたらします。

選択する際の基準としては、処理速度、精度、モデルの軽量さが重要です。

不要情報除去による結果改善

検索結果のうち、スコアの低い情報をあえてカットすることで、不要な情報を排除し、生成時のハルシネーションを防ぐことができます。

この手法は、結果の品質を向上させるために非常に有効です。

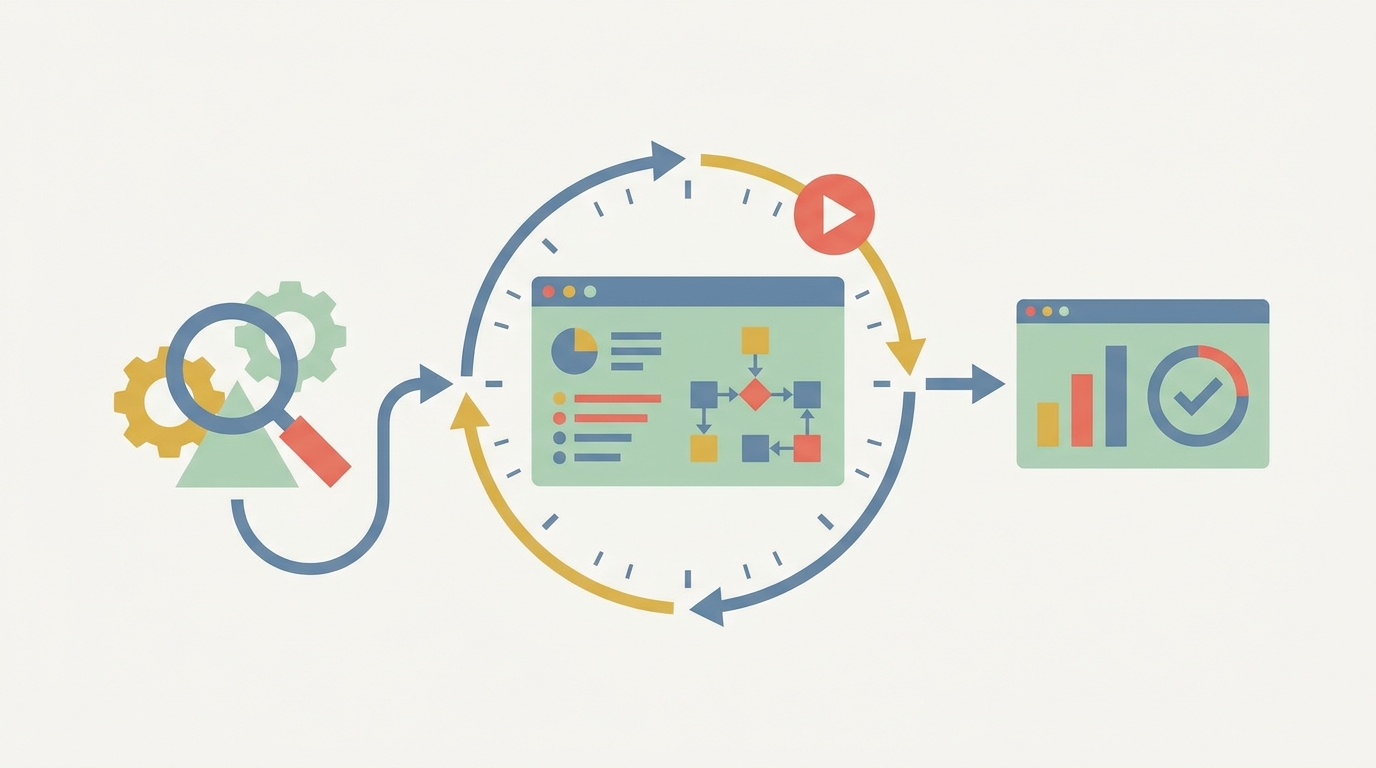

評価指標の導入とモニタリング手法

RAGの実装効果を測るためには、適切な評価指標を導入し、継続的にモニタリングすることが不可欠です。

Ragasを用いた忠実性指標や回答関連性の評価方法を中心に紹介します。

Ragasで計測する忠実性指標

Ragasは、生成される回答が元のデータとどれだけ忠実であるかを測るための指標です。

この指標を用いることで、ユーザーに提供する答えがどれほど信頼できるかを定量的に評価し、改善に役立てることができます。

回答関連性の評価方法

回答関連性は、ユーザーの質問に対する回答の適切さを評価する指標です。

この評価は、ユーザー体験を向上させるために非常に重要で、検索から生成までのプロセス全体の精度を向上させるための基礎となります。

定量評価によるモニタリングの流れ

定量評価を通じて、実装の有効性をモニタリングし続けることが重要です。

これにより、実装の問題点を早期に発見し、迅速に対処することが可能になります。

定期的な評価は、精度を維持し続けるために不可欠です。

改善サイクルへのフィードバック手法

評価結果をもとにフィードバックループを設計し、改善サイクルを継続的に回すことが求められます。

これにより、RAGのパフォーマンスを持続的に向上させることができます。

コスト最適化を実現するための工夫

RAGの実装において、コストを抑えながら精度を維持するための工夫が必要です。

高価なLLMへの依存を減らし、軽量モデルや前処理の組み合わせを活用する方法を考察します。

高価なLLM依存の軽減策

高価なLLMへの依存を減らすために、軽量モデルを併用することが有効です。

これにより、コストを削減しつつ、ある程度の精度を維持することが可能です。

軽量モデルは、特定の処理に特化しているため、効率的にリソースを活用できます。

軽量モデルと前処理の組み合わせ

軽量モデルを前処理と組み合わせることで、生成コストの削減と速度の向上を実現できます。

例えば、前処理で検索範囲を絞り込み、軽量モデルで迅速に処理することで、全体の効率を高めることができます。

コスト対効果の高い実装例

コスト対効果の高い実装の例としては、特定のタスクに最適化されたモデルを選択し、必要な部分だけを高精度に処理する方法があります。

このような実装は、限られたリソースで最大の価値を引き出すのに役立ちます。

低レイテンシ実現に向けた実装戦略

ユーザー体験を向上させるためには、応答速度の改善が不可欠です。

ここでは、応答速度向上のための技術や高度な処理を支える実装方法について解説します。

応答速度向上のための技術

応答速度を向上させるために、キャッシュを活用したり、非同期処理を導入することが有効です。

これらの技術を用いることで、処理時間を短縮し、ユーザーが待機する時間を最小限に抑えることができます。

高度な処理を支える実装方法

高度な処理を支えるためには、並列処理や分散システムの導入が考えられます。

これにより、大量のリクエストを効率的に処理することが可能となり、全体のスループットを向上させることができます。

RAG実装における評価・改善プロセスの手法

RAGの実装を評価し改善するプロセスを構築することは、システムの信頼性を向上させるために重要です。

ここでは、評価から改善へのプロセスやフィードバックループの構築について説明します。

評価から改善へのプロセス構築

評価から改善へのプロセスを構築するには、明確な目標を設定し、評価結果に基づいて迅速に改善策を講じることが必要です。

このプロセスを繰り返すことで、システムの性能を着実に向上させることができます。

フィードバックループの設計

効果的なフィードバックループを設計することで、継続的な改善が可能になります。

ユーザーのフィードバックや評価結果を活用して、システムの調整を行うことが重要です。

改善手法の選定基準

改善手法を選定する際には、実現可能性、コスト、効果を考慮する必要があります。

これにより、限られたリソースで最も効果的な改善を施すことができます。

評価結果を活用した最適化

評価結果をもとに最適化を行うことで、システムの信頼性と効率性を高めることができます。

定期的な評価と最適化は、長期的な成功を保証するために不可欠です。

アンチパターンと避けるべき実装の落とし穴

RAGの実装には、注意すべきアンチパターンや避けるべき落とし穴があります。

これらに注意することで、精度や効率を損なうことなく最適な実装を追求できます。

過度な分割のリスク

データを過度に分割すると、情報が断片化され、文脈が失われてしまうリスクがあります。

必要以上に細かく分割することは避け、適切な粒度でチャンク化することが重要です。

メタデータ詰め込みすぎの弊害

メタデータを過剰に詰め込むと、検索や処理が遅くなるだけでなく、ノイズが増えてしまいます。

必要最低限のメタデータで効率的な検索を心掛けることが求められます。

アンチパターン回避のためのチェックリスト

アンチパターンを回避するためのチェックリストを用意し、実装時に確認することで、誤った方向に進むことを防げます。

これには、分割の適切さ、メタデータの簡潔さ、検索の効率性などが含まれます。